Шахрайство складають більшість незаконної діяльності в секторі криптовалют. Про це свідчать дані Федерального бюро розслідувань (ФБР). Минулого року громадяни США втратили 9,3 мільярда доларів через криптошахрайство.

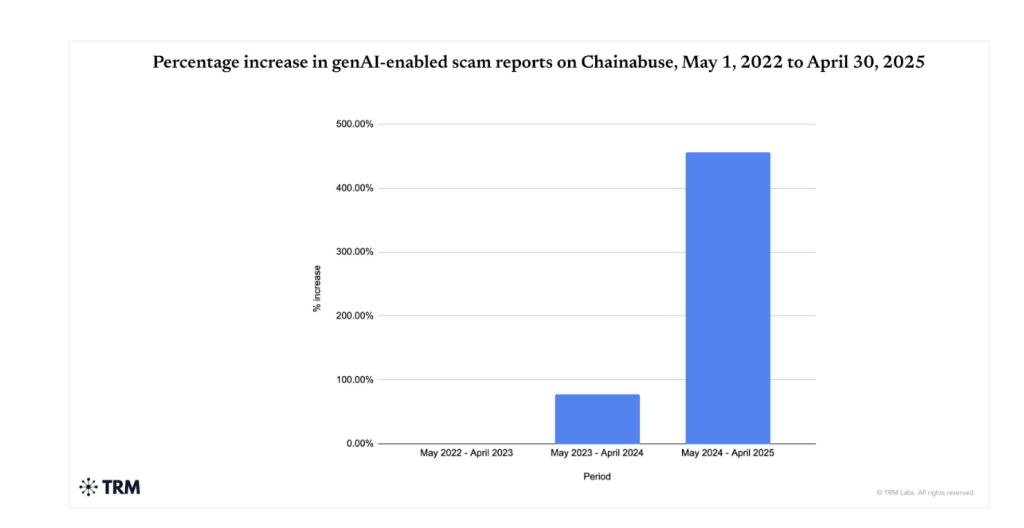

Розвиток штучного інтелекту (ШІ) лише погіршив ситуацію. За даними аналітичної фірми блокчейну TRM Labs, було 456% зростання шахрайства за допомогою ШІ у 2024 році порівняно з попередніми роками.

як генеративний ШІ (GenAI).зловмисники тепер можуть розгортати складні чат-боти, глибокі фейкові відео, клоновані голоси та автоматизовані мережі шахрайських токенів у небачених раніше масштабах. У результаті криптошахрайство більше не є операцією, керованою людьми, а швидше алгоритмічною, швидкою, адаптивною та все більш переконливою.

Шахрайство просувається блискавично

Арі Редборд, глобальний керівник відділу політики та урядових справ TRM Labs, сказав Cryptonews, що генеративні моделі використовуються для запуску тисяч шахраїв одночасно. «Ми бачимо кримінальну екосистему, яка є розумнішою, швидшою та нескінченно масштабованою», – сказав він.

Редборд пояснив, що моделі GenAI можуть налаштовуватися на мову, місцезнаходження та цифровий слід жертви. Наприклад, він зазначив, що у програмах-вимагачах штучний інтелект використовується для вибору жертв, які, швидше за все, платять, складання вимог щодо викупу та автоматизації чатів для переговорів.

У сфері соціальної інженерії Редборд згадав, що підроблені голоси та відео використовуються для обману компаній і людей у «видачі себе за посаду керівника» та шахрайстві «надзвичайних сімейних обставин».

Нарешті, шахрайство в ланцюжку із залученням інструментів штучного інтелекту, які пишуть сценарії, може переміщувати кошти через сотні гаманців за секунди, відмиваючи їх із швидкістю, з якою не зможе зрівнятися жодна людина.

Захист на основі ШІ

Криптоіндустрія звертається до засобів захисту на основі ШІ, щоб протистояти цим шахрайствам. Компанії з аналізу блокчейнів, компанії з кібербезпеки, біржі та академічні дослідники зараз створюють системи машинного навчання, призначені для виявлення, позначення та пом’якшення шахрайства задовго до того, як жертви втратять кошти.

Наприклад, Редборд заявив, що штучний інтелект вбудовано в кожен рівень інтелектуальної платформи блокчейну TRM Labs. Фірма використовує машинне навчання для обробки трильйонів точок даних у понад 40 мережах блокчейн. Це дозволяє TRM Labs відображати мережі гаманців, визначати типології та виявляти аномальну поведінку, яка вказує на потенційну незаконну діяльність.

“Ці системи не просто виявляють закономірності — вони вивчають їх. У міру того як змінюються дані, змінюються й моделі, адаптуючись до динамічної реальності крипторинків”, — прокоментував Редборд.

Це дає змогу лабораторіям TRM Labs побачити те, що слідчі могли б упустити інакше — тисячі дрібних, здавалося б, не пов’язаних між собою транзакцій, які є ознаками шахрайства, мережі відмивання коштів або кампанії програм-вимагачів.

Платформа ризиків штучного інтелекту Sardine використовує подібний підхід. Охоронну компанію було засновано у 2020 році, коли відомі криптошахрайства тільки почали відбуватися.

Алекс Кушнір, керівник відділу комерційного розвитку Sardine, розповів Cryptonews, що система виявлення шахрайства зі штучним інтелектом компанії складається з трьох рівнів.

“Дані є основою всього, що ми робимо. Ми фіксуємо глибокі сигнали, що стосуються кожного сеансу користувача, який відбувається на фінансових платформах, таких як криптобіржі, як-от атрибути пристрою, чи втручаються додатки чи поведінка користувача. По-друге, ми використовуємо широку мережу надійних постачальників даних для будь-яких введень користувачами. Нарешті, ми використовуємо дані нашого консорціуму, які можуть бути найважливішими для боротьби з шахрайством, де компанії можуть ділитися даними, пов’язаними з зловмисниками. інші компанії».

Кушнір додав, що Sardine використовує систему ризиків у реальному часі, щоб діяти на основі кожного з індикаторів, згаданих вище, щоб боротися з шахрайством, коли вони трапляються.

Кушнір також зазначив, що сьогодні агентний ШІ та великі мовні моделі (LLM) використовуються в основному для автоматизації та ефективності, а не для виявлення шахрайства в реальному часі.

“Замість жорстких правил виявлення шахрайства, тепер будь-хто може просто ввести те, що йому потрібно, щоб оцінити правило, і агент штучного інтелекту створить його, перевірить і розгорне це правило для нього, якщо воно відповідає їхнім вимогам. Агенти штучного інтелекту можуть навіть заздалегідь рекомендувати правила на основі нових шаблонів. Але коли справа доходить до прогнозування ризику, машинне навчання все ще залишається золотим стандартом”, – сказав він.

Варіанти використання ШІ проти ШІ

Ці засоби вже довели свою ефективність.

Метт Вега, керівник персоналу Sardine, розповів Cryptonews, що як тільки Sardine виявляє шаблон, штучний інтелект компанії проводить глибокий аналіз, щоб знайти рекомендації щодо тенденцій, щоб зупинити вектор атаки.

«Зазвичай на це людині знадобиться день, але використання ШІ займає секунди», — сказав він.

Наприклад, Vega пояснила, що Sardine тісно співпрацює з провідними криптобіржами, щоб позначати незвичну поведінку користувачів. Транзакції користувачів виконуються через платформу прийняття рішень Sardine, а аналіз штучного інтелекту допомагає визначити результат цих транзакцій, завчасно повідомляючи біржі.

У дописі в блозі TRM Labs далі пояснюється, що в травні компанія стала свідком прямого дипфейка під час відеодзвінка з ймовірним фінансовим шахраєм. Цей тип шахраїв встановлює довгострокові, довірливі та часто емоційні або романтичні стосунки з жертвою, щоб отримати доступ до її грошей.

«Ми підозрювали, що цей шахрай використовує технологію deepfake через неприродну лінію волосся людини», — пояснив Редборд. «Інструменти виявлення ШІ дозволили нам підтвердити нашу оцінку того, що зображення, ймовірно, створено ШІ».

Незважаючи на успіх TRM Labs, це конкретне шахрайство та інші, пов’язані з ним, вкрали близько 60 мільйонів доларів у невідомих жертв.

Компанія з кібербезпеки Kidas також використовує ШІ для виявлення та запобігання шахрайства. Рон Кербс, засновник і генеральний директор Kidas, розповів Cryptonews, що в міру того, як шахрайство на основі штучного інтелекту почастішало, власні моделі Kidas тепер можуть аналізувати вміст, поведінку та аудіовізуальні невідповідності в режимі реального часу, щоб ідентифікувати глибокі фейки та створений LLM фішинг у точці взаємодії.

«Це дозволяє миттєво оцінювати ризики та блокувати в режимі реального часу, що є єдиним способом протистояти автоматизованим масштабним операціям шахрайства», — сказав Кербс.

Кербс додав, що тільки минулого тижня інструмент Кідаса успішно перехопив дві різні спроби криптошахрайства в Discord.

«Ця швидка ідентифікація демонструє ключову здатність інструменту аналізувати поведінку в режимі реального часу, ефективно запобігаючи компрометації облікових записів користувачів і потенційним фінансовим втратам», — сказав він.

Захист від шахрайства на основі ШІ

Хоча очевидно, що інструменти на основі штучного інтелекту використовуються для виявлення та запобігання складним шахрайствам, ці атаки зростатимуть.

«Штучний інтелект знижує бар’єр проникнення для складних злочинців, роблячи ці шахрайства високомасштабованими та персоналізованими, тож вони, безумовно, отримають більшу популярність», — зазначив Кербс.

Кербс вважає, що напівавтономні зловмисні агенти штучного інтелекту незабаром зможуть організовувати цілі кампанії атак, вимагаючи мінімального людського нагляду з невідстежуваним голосовим підробленням під час живих дзвінків.

Незважаючи на тривогу, Вега зазначив, що існують конкретні кроки, які користувачі можуть вжити, щоб запобігти тому, щоб стати жертвою таких шахраїв.

Наприклад, він пояснив, що багато векторів атак є підробкою веб-сайтів, які користувачі зрештою відвідують, а потім натискають на підроблені посилання.

“Користувачі повинні шукати літери грецького алфавіту на веб-сайтах. Американська багатонаціональна технологічна компанія Apple нещодавно стала жертвою цього, оскільки зловмисник створив підроблений веб-сайт, використовуючи грецьку букву “A” в Apple. Користувачам також слід триматися подалі від рекламних посилань і звертати увагу на URL-адреси”.

Крім того, такі компанії, як Sardine і TRM Labs, тісно співпрацюють з регуляторами, щоб визначити, як побудувати огорожі, які використовують штучний інтелект для зниження ризику шахрайства на основі штучного інтелекту.

“Ми створюємо системи, які надають фахівцям із правоохоронних органів та комплаєнсу таку саму швидкість, масштаб і охоплення, які зараз мають злочинці, — від виявлення аномалій у реальному часі до ідентифікації скоординованого міжланцюгового відмивання. Штучний інтелект дозволяє нам перевести управління ризиками з реактивного на прогнозне”, — заявив Редборд.

Пост ШІ проти ШІ: як нові технології борються зі складними криптошахрайствами вперше з’явився на Криптоновини.